Pernahkah Anda bertanya-tanya mengapa komputer modern dengan prosesor sangat cepat masih terasa lambat saat memproses data dalam jumlah besar? Jawabannya terletak pada sebuah masalah klasik yang sudah berusia lebih dari 70 tahun: von Neumann bottleneck. Bayangkan seorang koki berbakat yang harus bolak-balik ke gudang setiap kali membutuhkan bahan masakan tidak peduli seberapa cepat tangannya bekerja, waktu perjalanan ke gudang akan selalu memperlambat prosesnya. Inilah yang terjadi pada komputer konvensional, dan compute-in-memory hadir sebagai solusi radikal untuk mengubah paradigma ini sepenuhnya.

Memahami Akar Masalah: Von Neumann Bottleneck

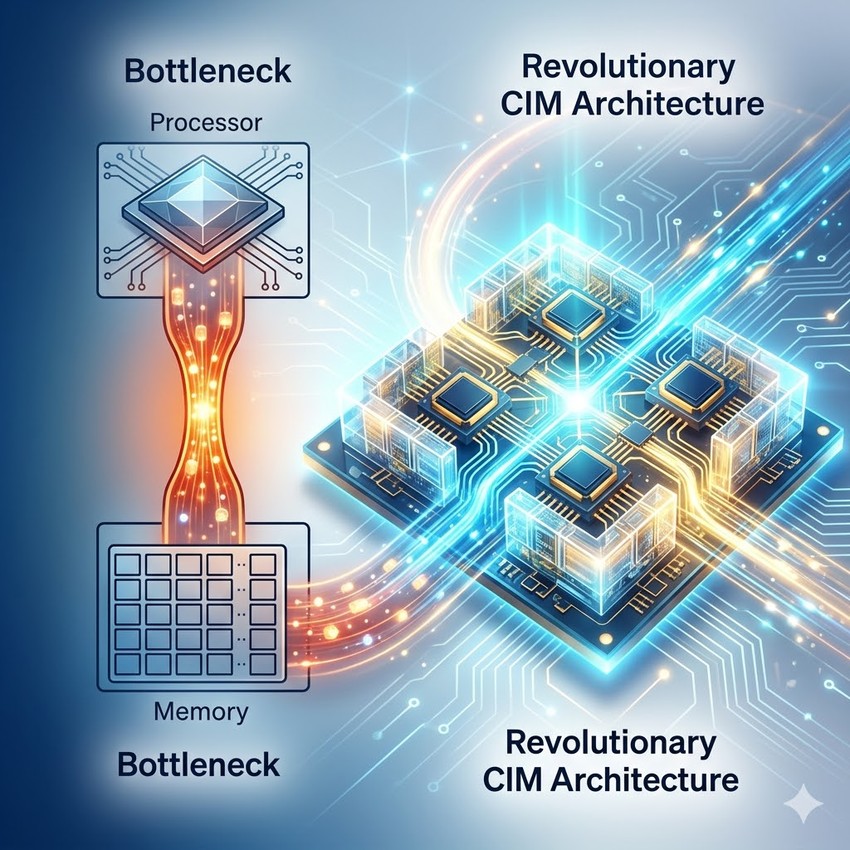

Arsitektur komputer yang kita gunakan hari ini sebagian besar masih mengikuti model yang diusulkan John von Neumann pada tahun 1945. Dalam model ini, CPU (unit pemrosesan) dan memori berada di lokasi terpisah, dihubungkan oleh jalur data yang disebut bus. Setiap kali CPU membutuhkan data untuk diproses, data tersebut harus ditransfer dari memori melalui bus ini.

Masalahnya? Kecepatan prosesor modern telah meningkat secara eksponensial mengikuti Hukum Moore, sementara kecepatan transfer data antara memori dan prosesor tidak mampu mengimbangi. Hasilnya adalah kesenjangan yang semakin lebar CPU seringkali harus menunggu data tiba sebelum bisa melanjutkan komputasi. Menurut riset dari Stanford University, hingga 90% waktu dan energi dalam aplikasi AI modern terbuang hanya untuk memindahkan data, bukan untuk melakukan perhitungan aktual.

Meskipun menggunakan GPU high-end, proses training terasa lambat karena GPU terus-menerus menunggu batch data baru dimuat dari RAM. Bottleneck ini bukan sekadar teori dampaknya sangat nyata dalam pekerjaan sehari-hari.

Compute-In-Memory: Memproses Data di Tempat Penyimpanannya

Compute-in-memory (CIM), juga dikenal sebagai processing-in-memory (PIM) atau in-memory computing, mengambil pendekatan yang secara fundamental berbeda. Alih-alih memindahkan data ke prosesor, CIM membawa kemampuan komputasi langsung ke dalam chip memori itu sendiri. Data diproses tepat di lokasi penyimpanannya, mengeliminasi kebutuhan transfer data yang mahal.

Konsep ini sebenarnya bukan hal baru ide awalnya sudah muncul sejak tahun 1960-an. Namun, baru dalam dekade terakhir teknologi fabrikasi semikonduktor cukup matang untuk mewujudkannya dalam bentuk chip yang praktis dan ekonomis. Kemunculan aplikasi AI dan machine learning yang sangat data-intensif menjadi katalis utama yang mendorong investasi besar-besaran dalam teknologi ini.

Cara Kerja Compute-In-Memory

CIM memanfaatkan karakteristik fisik dari sel memori untuk melakukan operasi matematika dasar. Dalam implementasi berbasis memristive (seperti ReRAM atau PCM), setiap sel memori dapat menyimpan nilai resistansi analog yang merepresentasikan bobot dalam jaringan neural. Ketika sinyal input dikirimkan melalui array sel ini, hukum Ohm dan Kirchhoff secara alami melakukan operasi perkalian dan penjumlahan operasi fundamental dalam komputasi matriks yang menjadi jantung deep learning.

Mari kita ilustrasikan dengan contoh sederhana. Dalam jaringan neural tradisional, operasi dot product antara vektor input dan matriks bobot membutuhkan ratusan siklus clock untuk mengambil data dari memori, melakukan perkalian di ALU, lalu menyimpan hasilnya kembali. Dengan CIM, seluruh operasi ini dapat diselesaikan dalam satu siklus input diterapkan sebagai tegangan, bobot tersimpan sebagai resistansi, dan hasilnya langsung tersedia sebagai arus output.

Teknologi Memori yang Mendukung CIM

Beberapa jenis teknologi memori sedang dikembangkan untuk implementasi CIM, masing-masing dengan kelebihan dan tantangannya:

- SRAM-based CIM: Menggunakan memori SRAM konvensional dengan modifikasi pada peripheral circuit. Keunggulannya adalah kompatibilitas dengan proses fabrikasi existing, namun densitas penyimpanan terbatas.

- ReRAM (Resistive RAM): Menawarkan densitas tinggi dan kemampuan analog computing yang sangat baik. Perusahaan seperti Mythic dan Syntiant menggunakan teknologi ini untuk chip AI edge.

- MRAM (Magnetoresistive RAM): Menggabungkan non-volatilitas dengan endurance tinggi, menjadikannya kandidat kuat untuk aplikasi yang membutuhkan ketahanan terhadap power cycling.

- PCM (Phase-Change Memory): Intel dan IBM telah menginvestasikan riset signifikan dalam PCM untuk CIM, memanfaatkan kemampuannya menyimpan multiple bit per sel.

Implementasi Nyata dan Pemain Industri

Compute-in-memory bukan lagi sekadar konsep laboratorium. Beberapa perusahaan telah meluncurkan produk komersial yang mengimplementasikan teknologi ini:

Mythic telah mengembangkan chip M1076 yang menggunakan arsitektur analog CIM untuk inferensi AI. Chip ini mampu mencapai efisiensi energi hingga 25 TOPS/Watt jauh melampaui GPU konvensional yang biasanya berkisar di angka 1-5 TOPS/Watt untuk edge deployment.

Syntiant fokus pada aplikasi audio AI dengan chip NDP120 yang menggunakan CIM untuk always-on voice processing dengan konsumsi daya kurang dari 1 mW. Produk mereka sudah terintegrasi dalam earbuds dan smart speakers dari berbagai merek.

Samsung pada tahun 2022 mengumumkan HBM-PIM, memori High Bandwidth Memory dengan kemampuan processing terintegrasi. Teknologi ini menargetkan akselerasi AI di data center dengan peningkatan efisiensi energi hingga 70% dibanding solusi konvensional.

IBM Research secara konsisten mempublikasikan breakthrough dalam analog AI chip berbasis PCM, mendemonstrasikan akurasi yang mendekati digital computing dengan efisiensi energi yang jauh lebih tinggi.

Keunggulan yang Transformatif

Adopsi compute-in-memory membawa beberapa keuntungan signifikan yang sulit dicapai dengan arsitektur konvensional:

Perbandingan Arsitektur Konvensional vs Compute-In-Memory

Efisiensi Energi

Pada arsitektur konvensional, efisiensi energi berada pada level baseline karena sebagian besar energi digunakan untuk memindahkan data antara memori dan prosesor. Compute-In-Memory jauh lebih efisien, bahkan dapat mencapai 10–100 kali lebih hemat energi karena proses komputasi dilakukan langsung di dalam memori.

Latency

Sistem konvensional memiliki latency yang relatif tinggi karena dibatasi oleh proses memory access antara CPU dan RAM. Pada Compute-In-Memory, latency dapat menjadi hampir instan (single cycle) karena data tidak perlu dipindahkan ke unit komputasi terpisah.

Throughput

Arsitektur tradisional umumnya hanya mendukung pemrosesan sequential atau paralel terbatas. Compute-In-Memory memungkinkan massive parallelism, di mana banyak operasi dapat dilakukan secara bersamaan langsung di memori.

Data Movement

Pada sistem konvensional, 60–90% konsumsi energi sering kali berasal dari proses pemindahan data antara memori dan prosesor. Compute-In-Memory meminimalkan perpindahan data ini karena komputasi terjadi di lokasi data berada.

Form Factor

Arsitektur konvensional biasanya membutuhkan sistem pendingin aktif karena konsumsi daya yang tinggi. Sebaliknya, Compute-In-Memory cenderung memiliki desain lebih compact dan dalam banyak kasus dapat menggunakan passive cooling.

Tantangan dan Limitasi

Meskipun menjanjikan, compute-in-memory menghadapi beberapa tantangan teknis yang masih dalam proses penyelesaian:

Presisi dan Noise: Komputasi analog inherently lebih rentan terhadap noise dan variasi dibanding digital. Ini dapat menyebabkan penurunan akurasi pada model yang membutuhkan presisi tinggi. Berbagai teknik seperti noise-aware training dan hybrid analog-digital architecture sedang dikembangkan untuk mengatasi masalah ini.

Programmability: Chip CIM cenderung kurang fleksibel dibanding prosesor general-purpose. Mereka dioptimalkan untuk operasi spesifik (terutama matrix-vector multiplication) dan mungkin tidak efisien untuk jenis komputasi lain.

Variabilitas Fabrikasi: Teknologi memori emerging seperti ReRAM dan PCM masih menghadapi tantangan dalam konsistensi karakteristik antar sel. Hal ini membutuhkan teknik kalibrasi dan kompensasi yang sophisticated.

Ekosistem Software: Toolchain untuk mengembangkan dan mengoptimalkan model pada hardware CIM masih belum sematang ekosistem untuk GPU atau TPU. Developer perlu framework baru yang memahami karakteristik unik arsitektur ini.

Dampak pada Masa Depan Teknologi

Compute-in-memory berpotensi mengubah landscape teknologi di beberapa domain kritis:

Edge AI: Dengan efisiensi energi yang luar biasa, CIM memungkinkan deployment model AI sophisticated pada perangkat battery-powered seperti wearables, drone, dan sensor IoT. Bayangkan kamera keamanan yang mampu melakukan real-time object detection tanpa memerlukan koneksi cloud.

Autonomous Vehicles: Mobil otonom membutuhkan kemampuan inferensi real-time dengan latency ultra-rendah. CIM dapat memproses data sensor dalam mikrodetik, memberikan waktu reaksi yang krusial untuk keselamatan.

Healthcare: Perangkat medis implantable seperti neural interfaces membutuhkan pemrosesan sinyal otak secara real-time dengan konsumsi daya minimal. CIM adalah enabler teknologi yang sempurna untuk aplikasi ini.

Data Center: Meskipun cloud computing memiliki akses ke daya melimpah, CIM tetap menarik karena dapat mengurangi kebutuhan cooling dan meningkatkan throughput per watt faktor kritis mengingat skala operasi data center modern.

Perspektif dan Prediksi

Setelah mengikuti perkembangan teknologi ini selama beberapa tahun, saya melihat compute-in-memory berada di titik infleksi yang mirip dengan GPU computing sekitar 2012 ketika deep learning mulai memanfaatkan akselerasi GPU dan mengubah lanskap AI sepenuhnya.

Dalam 5-10 tahun ke depan, saya memperkirakan CIM akan menjadi arsitektur dominan untuk edge AI, sementara hybrid approach yang menggabungkan CIM dengan prosesor digital konvensional akan mendominasi data center. Standardisasi interface dan tooling akan menjadi faktor kunci yang menentukan kecepatan adopsi.

Yang menarik adalah bagaimana CIM dapat berkonvergensi dengan teknologi lain seperti neuromorphic computing dan quantum computing untuk menciptakan paradigma komputasi yang sepenuhnya baru di mana batasan antara memori dan prosesor benar-benar menghilang.

Kesimpulan

Compute-in-memory merepresentasikan pergeseran fundamental dalam cara kita merancang sistem komputasi. Dengan memecahkan von Neumann bottleneck yang telah membatasi performa komputer selama puluhan tahun, teknologi ini membuka pintu menuju era baru efisiensi dan kemampuan yang sebelumnya tidak terbayangkan.

Bagi developer dan engineer, ini adalah saat yang tepat untuk mulai memahami arsitektur CIM dan implikasinya. Meskipun mungkin tidak langsung mengubah cara kita menulis kode hari ini, pemahaman tentang hardware yang mendasari aplikasi AI akan menjadi semakin penting seiring teknologi ini mencapai adopsi mainstream. Compute-in-memory bukan sekadar evolusi ini adalah revolusi diam-diam yang sedang membentuk ulang fondasi komputasi modern.